Syntheva 推出 EPIA NPU

2025年11月11日

完整文章请见 这里。

我们很高兴分享 EPIA — 一种开放的 64 位 NPU 架构,专为真正的设备端 AI 设计。在您将其归为“又一款边缘 AI NPU”之前,请稍作停顿—EPIA 支持超大模型—从最小的 7B 模型起,轻松扩展到 160B。该架构本身可支持更大规模的多万亿参数模型,但硬件实现可能尚未达到这一规模。

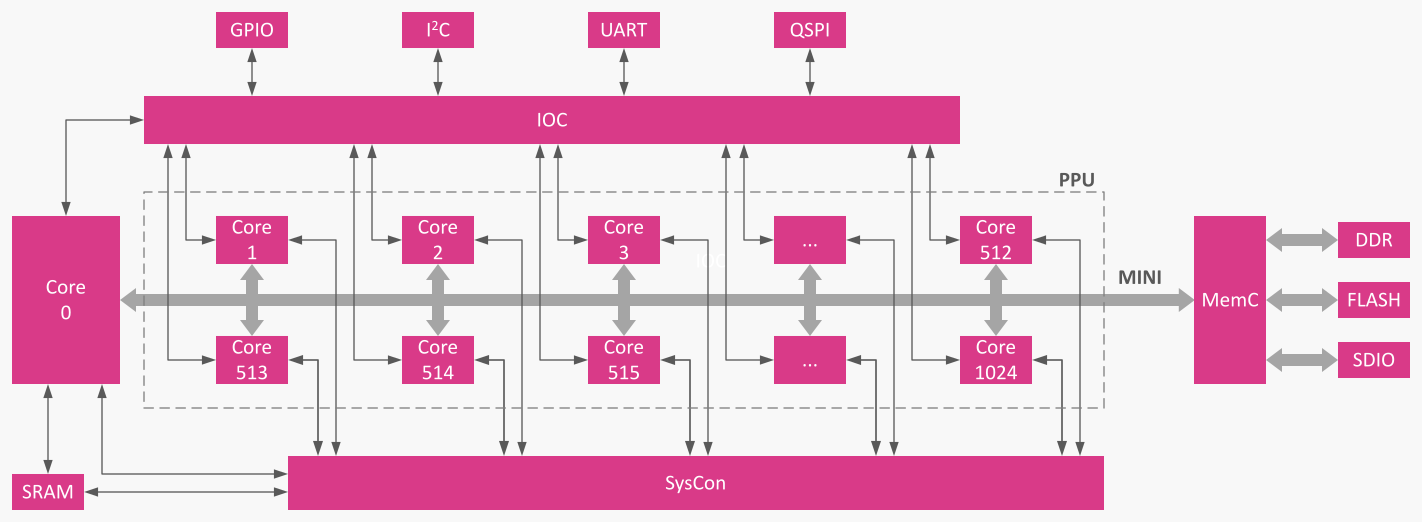

EPIA 轻量、可预测,并针对当下需求设计:机器人领域终于需要具备私密、离线智能、确定性延迟且无供应商锁定的解决方案。我们构建了正交 ISA、低位推理的缩放点积单元(Scaled Dot-Product Unit)、以及简单的 PPU 代码流分发模型,使并行工作清晰且高效。MINI 总线、MemC 和 IOC 让张量流、模型从闪存/SD 分页加载,以及控制机器人身体模块变得轻松,无需庞大的驱动堆栈。

重要性何在:开发人形机器人及其他机器人团队需要自主性、可审计性,以及可扩展的生态系统 — 而非依赖笨重的封闭 GPU 或云服务。通过开源 EPIA,我们希望建立一个类似 RISC-V 的社区:工具链、编译器、核心及来自各方的真实硬件贡献。

典型部署方式?机器人上可配置一个或多个 EPIA 芯片:视觉 (VLM)、语音 (ASR/TTS)、推理 (LLM + 行为模型) 及控制管线 — 全部本地执行,可从单芯片扩展至多芯片部署,具备可预测延迟与完全数据隐私。

如果您关心设备端自主性或希望参与打造开放 NPU 堆栈,让我们携手合作!